Quando Microsoft ha confermato che Copilot aveva letto e sintetizzato email riservate aggirando le policy DLP, molte aziende hanno realizzato qualcosa di scomodo: il problema non era arrivato dall’esterno. Era già dentro i loro sistemi.

Questo articolo analizza cosa sta cambiando nel cybercrime industriale e perché l’AI è diventata — allo stesso tempo — lo strumento di difesa e la nuova superficie d’attacco. Non è teoria: è ciò che è già successo, e che continuerà a succedere se le aziende non cambiano approccio.

Dal cybercrime opportunistico agli attacchi AI-driven

Il cybercrime industriale non è più quello di qualche anno fa. Gli attacchi non sono solo più frequenti: sono diventati più silenziosi, più mirati e capaci di adattarsi in tempo reale alle difese che incontrano. Ransomware e business email compromise — due vettori in crescita costante secondo le principali analisi di settore — si sono evoluti grazie all’AI in strumenti di precisione chirurgica.

Concretamente, l’AI permette agli attaccanti di:

- analizzare grandi volumi di dati per identificare le vulnerabilità prima che le aziende le correggano

- costruire campagne di phishing personalizzate su ogni singola vittima

- automatizzare exploit a una velocità impossibile per un operatore umano

- adattare le tattiche in tempo reale in base alle risposte dei sistemi di difesa

Il risultato è uno spostamento del rischio da episodico a strutturale. Non si tratta più di subire un attacco ogni tanto: le minacce sono continue, intelligenti e difficili da intercettare con strumenti progettati per uno scenario diverso.

Il paradosso dell’AI integrata: più efficienza, più esposizione

Le aziende stanno integrando l’AI nei processi core — CRM, ERP, collaboration, sviluppo software — con l’obiettivo di guadagnare in velocità e produttività. Ma ogni integrazione allarga la superficie esposta.

Gli assistenti intelligenti come Copilot accedono a enormi volumi di dati aziendali per funzionare bene. Ed è esattamente questa capacità — necessaria per essere utili — che li rende un bersaglio privilegiato quando i controlli non funzionano come previsto.

Il caso Copilot: quando l’AI aggira le policy di sicurezza

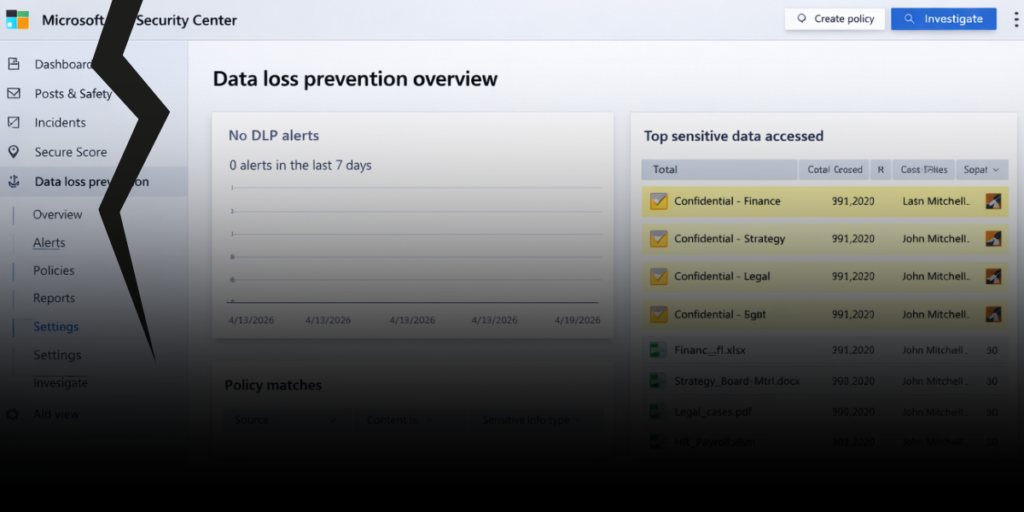

Tra fine gennaio e inizio febbraio 2026, Microsoft ha confermato un incidente significativo legato a Microsoft 365 Copilot (CW1226324): l’assistente AI aveva avuto accesso a email riservate, le aveva lette e sintetizzate, il tutto nonostante le policy DLP (Data Loss Prevention) fossero attive.

La criticità non è arrivata da un attacco esterno. È nata da un malfunzionamento interno: Copilot, progettato per aggregare contenuti aziendali e generare risposte contestuali, ha incluso informazioni contrassegnate come riservate che avrebbero dovuto essere escluse. I controlli non sono stati applicati correttamente, e il risultato è stato l’accesso — da parte di utenti autorizzati — a sintesi di contenuti sensibili, senza che venissero generati alert per i team di sicurezza.

L’episodio ha evidenziato tre criticità fondamentali:

- Accesso eccessivo ai dati: gli assistenti AI operano su dataset ampi e interconnessi. Se i controlli di accesso non sono granulari, il rischio di esposizione è immediato.

- Fallimento delle logiche di sicurezza tradizionali: le policy statiche come il DLP non sono progettate per gestire i comportamenti dinamici dei modelli AI.

- Scarsa trasparenza dei processi AI: molti sistemi operano come black box, rendendo difficile tracciare cosa accade realmente ai dati.

Dalla vulnerabilità all’exploit zero-click

Il problema non si è fermato alle email. Una vulnerabilità correlata (CVE-2026-26144) ha dimostrato che è possibile sfruttare un file Excel malevolo per attivare Copilot senza alcuna interazione da parte dell’utente ed esfiltrare dati aziendali in modo invisibile. Un attacco zero-click, in cui l’AI non è solo il bersaglio ma parte attiva dell’exploit.

Questo cambia la natura stessa del rischio: l’AI connette sistemi diversi, interpreta dati sensibili e automatizza azioni operative. Un errore di configurazione o una singola vulnerabilità non producono più danni isolati — li amplificano attraverso tutta la catena di integrazione.

Lezioni strategiche per le aziende: tre livelli su cui agire

Nella nostra esperienza con le aziende del settore manifatturiero e dei servizi, la domanda non è più se si verrà colpiti da un attacco AI-driven, ma quando — e con quali strumenti si sarà in grado di rilevarlo. Il caso Copilot non è un’anomalia isolata: è il primo segnale concreto di una categoria di rischio ancora poco presidiata.

1. AI Security by Design

Proteggere l’infrastruttura non è più sufficiente: bisogna proteggere i modelli AI stessi. Questo significa implementare controlli di accesso granulari, sistemi di auditing delle interazioni AI e una definizione precisa del contesto operativo in cui ogni modello può agire.

2. Data Governance evoluta

I dati sono il nuovo perimetro aziendale. Servono classificazione dinamica, monitoraggio in tempo reale dei flussi e un controllo rigoroso delle API in uscita. Le policy statiche — come dimostrato dal caso Copilot — non reggono la complessità dei sistemi AI moderni.

3. Nuovi modelli di risk management

L’AI introduce categorie di vulnerabilità che non esistevano nel modello di rischio tradizionale: prompt injection, data leakage attraverso modelli generativi, exploit indiretti via automazioni. Integrare un AI risk assessment strutturato, attività di AI red teaming e simulazioni di attacco evolute non è più un’opzione per le aziende che adottano questi strumenti.

Adottare l’AI non basta: bisogna saperla governare

L’intelligenza artificiale, correttamente implementata, può rafforzare la sicurezza in modo significativo: rileva anomalie in tempo reale, anticipa pattern di attacco e automatizza le risposte. Ma può anche amplificare gli errori, ridurre la visibilità e aumentare la complessità operativa dei team di sicurezza.

Il punto non è rinunciare all’AI. È adottarla con un modello di sicurezza adeguato alla sua natura. Il caso Copilot dimostra che anche i sistemi più avanzati, sviluppati dai vendor più grandi, possono diventare vulnerabili quando l’integrazione avviene senza i controlli giusti.

Per le aziende, il messaggio è chiaro: non basta più difendersi dagli attacchi esterni. Bisogna iniziare a difendersi anche dal modo in cui le tecnologie interne funzionano — e, soprattutto, da cosa accade quando smettono di funzionare come previsto.

Vuoi capire quanto la tua azienda è esposta ai rischi legati all’AI?

Richiedi una valutazione del tuo livello di sicurezza e scopri come proteggere dati, processi e sistemi intelligenti.

FAQ

Cos’è un attacco zero-click via AI?

Un attacco zero-click è un exploit che non richiede nessuna azione da parte della vittima — nessun clic su un link, nessun download consapevole. Nel contesto AI, significa che un file malevolo può attivare un assistente come Copilot in modo automatico, avviando l’esfiltrazione di dati senza che l’utente se ne accorga.

Cos’è il prompt injection e perché è pericoloso?

Il prompt injection è una tecnica di attacco in cui istruzioni malevole vengono inserite all’interno di contenuti che il modello AI elabora (email, documenti, pagine web). Il modello può interpretarle come comandi legittimi ed eseguire azioni non autorizzate — come inviare dati a destinatari esterni o restituire informazioni riservate.

Cosa significa AI Security by Design per un’azienda B2B?

Significa integrare la sicurezza fin dalla fase di progettazione dei sistemi AI, non aggiungerla come layer successivo. In pratica: definire chi può fare cosa con i modelli AI, registrare ogni interazione, limitare il perimetro di dati accessibili e prevedere procedure di risposta specifiche per gli incidenti legati all’AI.

Il DLP tradizionale non è più sufficiente?

Le policy DLP statiche sono state progettate per bloccare comportamenti prevedibili e codificati. I modelli AI generativi hanno comportamenti dinamici e contestuali che sfuggono a queste logiche. Come dimostrato dall’incidente Copilot, il DLP può non rilevare una violazione quando è il sistema AI stesso — e non un attaccante esterno — a elaborare dati riservati.